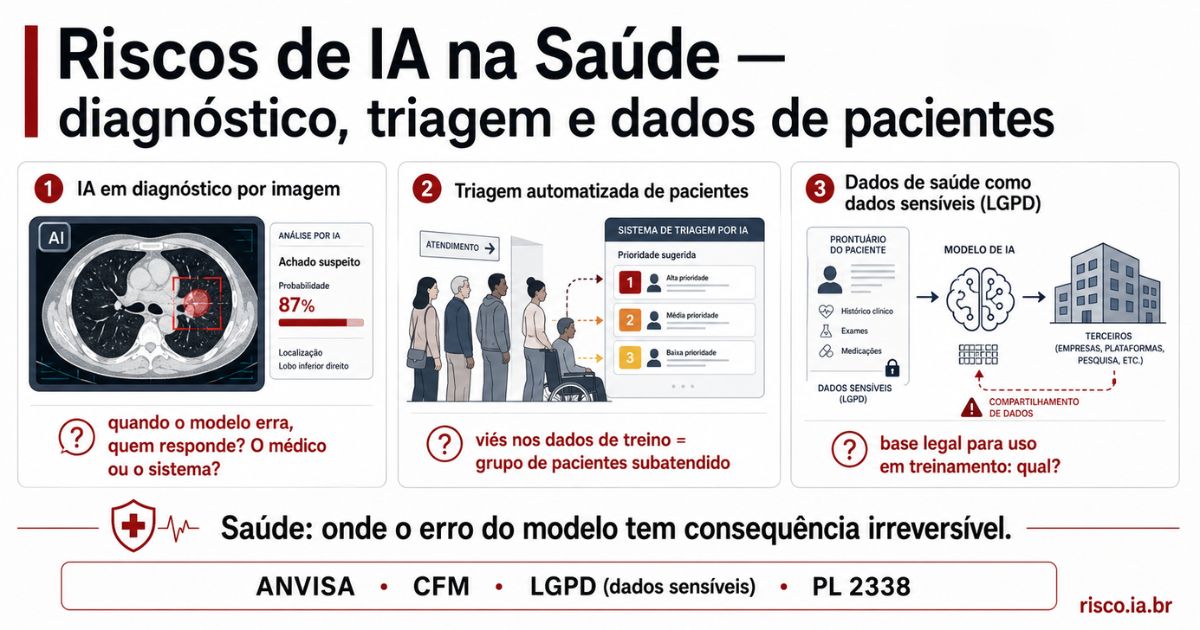

Saúde tem três camadas de regulação para IA: a LGPD com proteção reforçada para dados sensíveis, a ANVISA para software como dispositivo médico (SaMD), e o CFM com responsabilidade médica em decisões assistidas por IA. Um sistema de IA de triagem ou diagnóstico pode estar simultaneamente no escopo das três regulações — com requisitos diferentes e fiscalizadores diferentes.

Riscos prioritários para o setor

Diagnóstico por IA sem supervisão médica documentada

O CFM estabelece que a responsabilidade pelo diagnóstico é do médico — mesmo quando assistido por IA. Se o sistema de IA de diagnóstico não tem processo documentado de revisão médica, você tem risco de responsabilidade civil e ética médica sem defesa estruturada.

O que fazer: documentar o fluxo de supervisão humana para cada sistema de IA de diagnóstico. O médico responsável precisa estar identificado na trilha de auditoria de cada decisão.

Dados de prontuário em LLM externo — categoria especial da LGPD

Dados de saúde são categoria especial na LGPD. Processamento por LLM externo sem base legal explícita é violação grave. A base legal para dados de saúde é mais restrita do que para dados comuns — consentimento específico ou hipótese legal específica.

O que fazer: mapear todos os sistemas que processam dados de prontuário com IA. Para cada um: identificar a base legal usada. Dado de saúde em LLM externo sem DPA específico é exposição imediata.

IA de triagem sem baseline — você não sabe se piorou o processo

Triagem automatizada que não tem baseline do processo anterior não pode demonstrar melhora — nem investigar deterioração.

ANVISA — Software como Dispositivo Médico (SaMD)

Sistemas de IA que auxiliam diagnóstico ou tratamento podem ser classificados como SaMD pela ANVISA — com obrigação de registro, validação clínica e notificação de incidentes. A maioria das empresas de saúde não verifica essa classificação antes de implantar.

Ver todos os riscos por categoria: Regulatório · Operacional · Auditoria